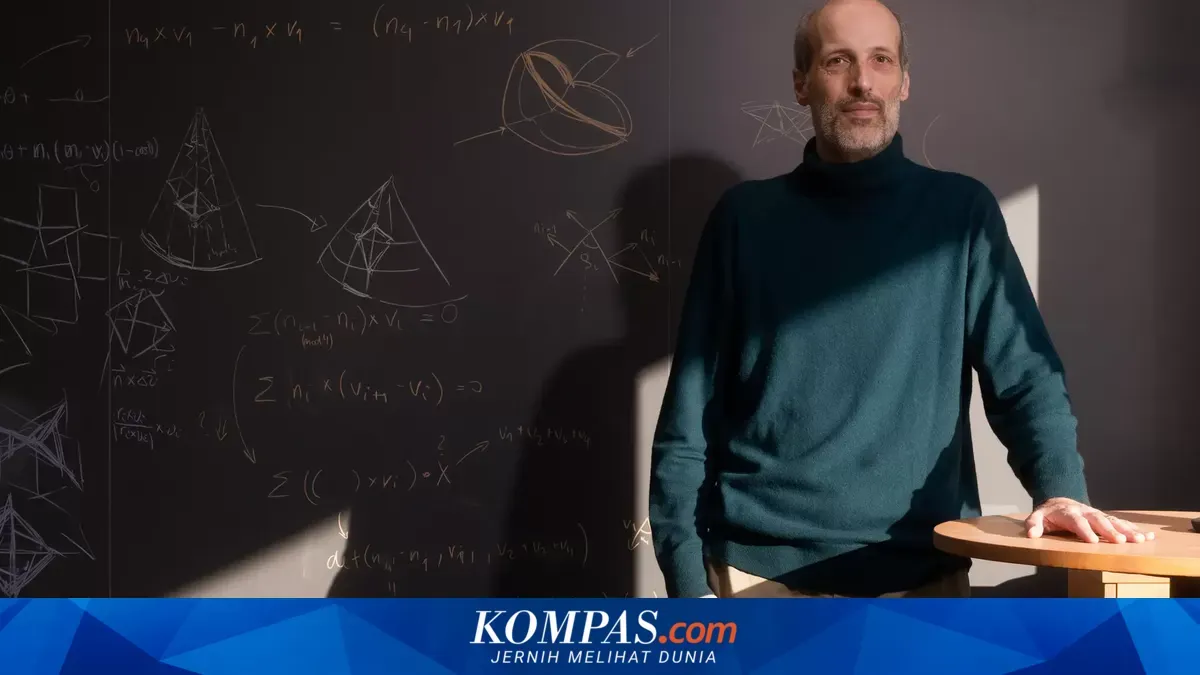

Profesor matematika Martin Hairer, peraih Fields Medal 2014, bersama tim matematikawan dari Harvard, Stanford, dan MathSci.ai menguji kemampuan sejumlah model Artificial Intelligence (AI) dalam menyelesaikan soal matematika yang mereka susun sendiri. Dalam pengujian tersebut, jawaban AI dinilai kerap tidak akurat dan cenderung “mengarang” pada bagian-bagian krusial pembuktian.

Eksperimen bertajuk First Proof itu berangkat dari kekhawatiran seorang siswa SMA yang mengirim e-mail kepada Hairer. Siswa tersebut merasa masa depan di bidang matematika terancam seiring kemampuan AI yang terus meningkat. Hairer menilai matematika masih “aman” dari ancaman AI, meski ia mengakui model bahasa besar (Large Language Model/LLM) seperti ChatGPT mampu menyelesaikan soal latihan standar yang jawabannya telah banyak beredar.

Menurut Hairer, ia belum melihat contoh yang masuk akal ketika LLM menghasilkan ide atau konsep matematika yang benar-benar orisinal. “Saya belum melihat contoh yang masuk akal di mana LLM menghasilkan ide atau konsep baru yang benar-benar orisinal,” ujarnya.

Untuk menguji klaim tersebut, tim kemudian menggunakan soal-soal riset yang belum pernah dipublikasikan, dengan tujuan memastikan AI tidak dapat mengambil jawaban dari data pelatihan di internet. Dalam pengujian ini, mereka menguji sejumlah model AI yang disebut sebagai yang paling canggih, termasuk ChatGPT-5.2 Pro dan Google Gemini 3.0 Deep Think.

Hasilnya, Hairer menilai jawaban AI mengecewakan. Ia bahkan menyamakan kualitasnya dengan “mahasiswa S1 yang kurang pintar”. Ia menjelaskan, model AI cenderung memberi detail panjang pada bagian yang relatif mudah, tetapi minim penjelasan pada inti argumen yang sulit. Dalam pandangannya, AI seolah memahami titik awal dan tujuan akhir, namun tidak mengetahui langkah yang benar untuk mencapai kesimpulan.

Akibatnya, AI dinilai sering melakukan hand-waving, yakni memberikan argumen yang kabur di bagian tengah pembuktian, seakan berharap pembaca tidak menyadari kelemahannya.

Berdasarkan temuan tersebut, tim menyimpulkan AI belum bisa menggantikan matematikawan. Mereka menyoroti beberapa keterbatasan, antara lain kelemahan dalam penalaran visual, sehingga soal yang membutuhkan imajinasi ruang cenderung sulit diselesaikan. Selain itu, kualitas jawaban AI disebut menurun ketika pembuktian menjadi panjang, misalnya lebih dari lima halaman, dan mulai menghasilkan jawaban yang tidak konsisten.

Tim juga menilai AI cenderung menjadi “yes man”. Tamara Kolda, salah satu penulis riset dari MathSci.ai, menyebut AI membosankan karena tidak bisa diajak berdebat. Menurutnya, kemajuan sains membutuhkan perdebatan gagasan, sementara AI cenderung mengikuti sudut pandang pengguna.

Selain itu, Lauren Williams, profesor matematika dari Harvard yang terlibat dalam riset, menemukan pola lain ketika AI dihadapkan pada masalah riset nyata. AI disebut kerap terjebak dalam “infinite loop”: memberikan jawaban, mengoreksi diri dengan menyatakan ada kesalahan, lalu mengajukan jawaban baru, dan kembali mengoreksinya berulang kali tanpa mencapai solusi akhir yang benar.

Kolda juga mengingatkan potensi dampak yang lebih luas. Ia menilai AI berisiko memperlambat kemajuan sains karena cenderung mengulang sudut pandang yang diperintahkan, berbeda dengan rekan kerja manusia yang dapat memberikan perspektif baru dan menantang.